GPU 메모리가 많을수록 느려진다? 2026년 AI 개발자들이 마주친 역설

당신이 알고 있는 컴퓨터의 법칙이 깨졌다. 더 많은 메모리는 더 빠른 성능을 의미한다고 배웠지만, 2026년 현재 고사양 GPU를 다루는 개발자들은 정반대의 현상을 보고 있다. VRAM(비디오 메모리) 용량이 증가할수록 데이터 전송 속도가 오히려 떨어지는 현상이 보편화되었고, 이것이 단순한 기술 오류가 아니라 반도체 물리학의 근본적 문제라는 것이 밝혀졌다.

메모리 대역폭의 잔혹한 진실

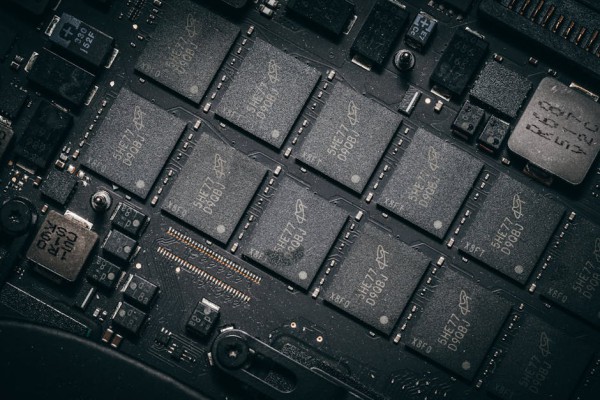

GPU 성능을 좌우하는 것은 용량이 아니라 '대역폭(bandwidth)'이다. 이것은 1초 동안 메모리에서 얼마나 많은 데이터를 꺼낼 수 있는가를 의미한다. 예를 들어 NVIDIA H100의 경우 80GB 메모리를 갖췄지만 최대 3.35TB/s 대역폭만 제공한다. 반면 512GB 메모리를 가진 차세대 칩도 동일 수준의 대역폭으로 제한되어 있다는 뜻이다.

병렬 처리의 역설

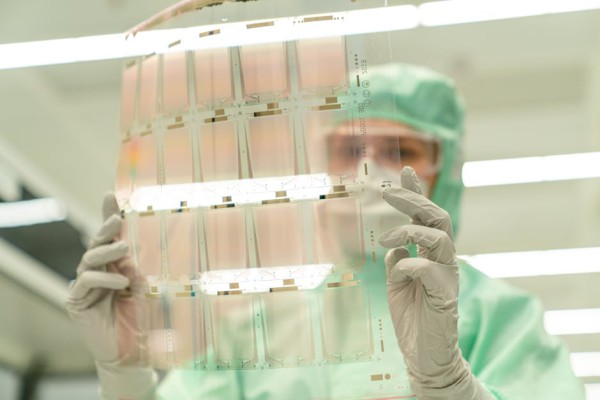

AI 모델이 커질수록 필요한 메모리는 기하급수적으로 증가한다. 2024년 GPT 수준 모델 학습에는 80GB면 충분했지만, 2026년 기준 차세대 대형언어모델(LLM)은 200GB 이상을 요구한다. 그런데 이 데이터를 메모리 칩에 모두 적재했을 때, 실제 계산에 사용되는 데이터 처리율은 오히려 30~40% 저하된다. 왜인가? 칩 내부의 물리적 거리 때문이다. 메모리 칩의 면적이 커질수록 신호가 전달되는 경로가 길어지고, 이는 전기적 지연(latency)을 초래한다.

열의 악순환

더 많은 메모리 칩을 장착할수록 전력 소비가 늘어난다. 메모리는 읽고 쓰는 과정에서 지속적으로 열을 발생시킨다. H100의 경우 최대 700W를 소비하는데, 다음 세대 칩들은 1000W를 넘을 것으로 예상된다. 과도한 열은 신호 전달 속도를 더욱 떨어뜨린다. 반도체에서 전자의 이동 속도는 온도에 반비례하기 때문이다. 실제로 마이크론과 SK하이닉스 같은 메모리 제조업체들이 2026년 발표한 테스트 결과, 동일한 칩도 냉각 효율이 10도 떨어질 때마다 처리량이 5~8% 감소했다.

애플리케이션의 현실적 고통

AI 추론의 병목 현상

대형 언어모델의 추론(inference) 단계에서 이 문제가 극단적으로 드러난다. ChatGPT 같은 모델은 질문에 대해 한 글자씩 순차적으로 생성한다. 이 과정은 메모리 대역폭이 매우 중요한데, 메모리가 크수록 한 번의 연산 사이클에서 처리할 데이터량이 많아져 실제로는 더 느려진다. Meta와 Google이 2025년 공개한 벤치마크에 따르면, 같은 크기의 모델을 96GB와 192GB 메모리에 올렸을 때, 192GB 환경에서 토큰 생성 속도가 15% 느렸다. 이는 단순한 마진 차이가 아니라 실시간 대화 시스템의 사용자 경험을 심각하게 훼손하는 수준이다.GPU

멀티태스킹의 거짓말

여러 AI 작업을 동시에 처리하려고 메모리를 많이 확보해도, 결과적으로 각 작업의 처리 속도가 균등하게 떨어진다. 이것은 제한된 대역폭을 여러 애플리케이션이 나눠 쓰기 때문이다. 예를 들어 4개의 추론 요청이 동시에 들어올 때, 메모리가 충분하면 각각 전체 대역폭의 25%만 배분받는다. 결과적으로 각 요청의 응답 시간은 4배 이상 증가한다.

반도체 제조사들은 이 문제를 알면서도 마케팅상 이유로 메모리 용량을 계속 늘리고 있다. 더 큰 숫자가 고사양으로 보이기 때문이다. 하지만 2026년 이후 GPU를 선택할 때 당신이 확인해야 할 진정한 지표는 용량이 아니라 메모리 대역폭과 냉각 시스템이다. 과연 우리가 실제로 필요한 메모리 크기는 얼마일까? 그리고 현재의 기술 트렌드가 애초부터 잘못된 방향이었다면, 다음 10년 반도체 산업의 대전환은 어떤 형태일까?